曹春生 - 盡信書,不如無書|學友智庫

46分鐘前

DSE開考懶人包2024|核心科/選修科精讀備戰攻略 + 解構扣分/DQ陷阱 + 惡劣天氣安排

2024-04-03 06:30

公主病與王子病 |黃副校長隨筆

2024-04-18 12:50

親子好去處2024︳ Ryze彈床樂園低至$29任玩1小時 40個彈跳床/障礙訓練場/高空滑索

2024-04-18 12:10

STEAM|打鐵花 習俗與化學驚艷結合|星島教室

2024-04-18 11:53

網傳DSE考生試前須出席國安活動 校方否認

2024-04-18 11:04

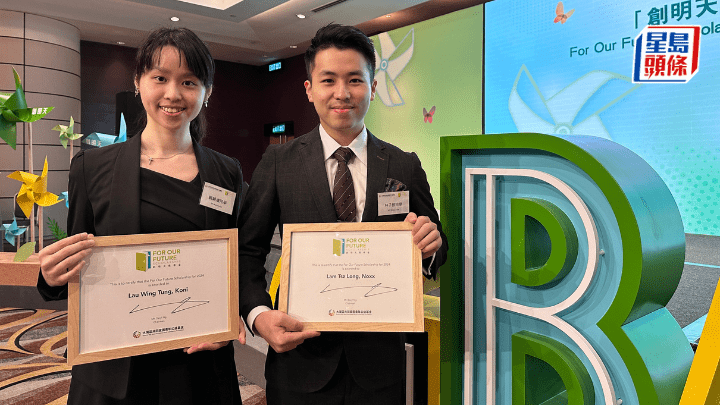

16名優秀大學生 獲頒「創明天獎學金」

2024-04-18 10:47

北都大學教育城|教育局:有院校擬整個校園遷北都 部分院校計劃在北都成立「衛星校園」

2024-04-18 00:55

新一期《親子王》7-11及OK便利店有售!即睇更多升學教育、教養溝通資訊

2024-04-18 00:02

孩子做事「三分鐘熱度」易放棄欠「韌力」 從運動員身上學逆轉戰局︳麥太育兒秘笈

2024-04-17 23:30